Nice to know: AI Act, Flux.1 und Empfehlungen in der Google Search Console

Keine Artikel mehr verpassen? Jetzt Newsletter abonnieren »

EU AI Act seit 01. August 2024 in Kraft

Am 01. August 2024 ist der EU AI Act in Kraft getreten. Dieser enthält Regelungen und Vorschriften, an die sich Anbieter sowie Nutzende von KI-Systemen halten müssen. Ziel ist es, den Umgang und den Einsatz von künstlicher Intelligenz für alle Beteiligten sicher zu gestalten und ein Umfeld zu schaffen, in dem künstliche Intelligenz für positive Zwecke genutzt und nicht missbraucht werden kann.

Nun müssen die Anforderungen nicht sofort umgesetzt werden. Stattdessen gibt es verschiedene zeitliche Rahmen, in denen Anpassungen vorgenommen werden können und Stichtage, bis zu denen die Vorschriften umgesetzt werden müssen.

Dazu ist es wichtig zu wissen, dass der AI Act KI-Systeme in unterschiedliche Risiko-Stufen einteilt:

- Inakzeptables Risiko: Hierbei handelt es sich um KI-Systeme, die fundamentale Rechte verletzen und genutzt werden, um menschliches Verhalten nachteilig zu beeinflussen oder Schwächen schutzbedürftiger Personen auszunutzen. Diese Systeme sind komplett verboten. Als Beispiel wird hier oft das Social Scoring System aus China genannt, bei dem Bürger:innen aufgrund ihres sozialen Verhaltens klassifiziert werden und einen Score bekommen. Dieser Score kann Auswirkungen auf den Beruf, die Reisefreiheit, die Kreditwürdigkeit, die zu zahlenden Steuern und sogar die Geschwindigkeit des Internetanschlusses in der eigenen Wohnung haben. Derartige Systeme dürfen in Europa nicht eingeführt werden.

- Hohes Risiko: Hierzu zählen Systeme, die z. B. kritische Infrastruktur, Biometrik oder sensible Daten betreffen. Dafür wurden spezielle Konformitätsanforderungen festgelegt, an welche Anbieter und Nutzende sich halten müssen. In diese Kategorie fallen beispielsweise Systeme, welche die Stromversorgung, die Luftfahrt, Kinderspielzeuge, Biometrik oder Kreditwürdigkeit betreffen. Wichtig für Unternehmen ist hier, dass beispielsweise auch Systeme darunter fallen, welche zur Be- oder Auswertung von Bewerbungsunterlagen dienen.

- Begrenztes Risiko: Hierzu zählen generative KI-Systeme, beispielsweise zur Erstellung von Text, Bild, Ton oder Audio. Diese Systeme nutzen wir häufig im Marketing, um Creatives oder Werbetexte zu erstellen. Auch Chatbots, die wir auf unseren Websites implementieren, fallen in diese Kategorie. Hier gilt die sogenannte Transparenzverpflichtung, was bedeutet, dass Nutzende darüber informiert werden müssen, dass sie mit einer KI interagieren, bzw. Inhalte müssen als KI-generiert gekennzeichnet werden.

- Niedriges Risiko: Hierunter fallen Systeme, welche nicht in die anderen 3 Kategorien passen. Dazu zählen vor allem interne Anwendungen, etwa Spam-Filter, Videospiele oder Systeme, welche die Wartung von Maschinen vorhersagen. Hier gibt es keine Verpflichtungen. Unternehmen werden allerdings dazu angehalten, freiwillige Kodizes zu implementieren.

Je größer das Risiko ist, welches von einer Plattform ausgeht, desto strenger sind die Vorgaben und Richtlinien, die eingehalten werden müssen. Entscheidend ist dabei nicht das KI-Modell an sich, sondern der konkrete Anwendungsfall.

Auf der Website artificualintelligenceact.eu findest du eine Zusammenfassung des AI Acts.

Den vollständigen Gesetzestext findest du direkt auf der Website der EU.

Made in Germany: Neues Bild-KI-Modell Flux.1

Eine neue Bild-KI mischt den Markt auf: Flux.1 vom deutschen Unternehmen Black Forest Labs. Black Forest Labs wirbt damit, dass Modell in vielen Kategorien besser abschneidet, als Midjourney, Dall-E & Co. Sie soll deutlich besser sein als die Modelle, die wir bisher kannten (z. B. Midjourney, Stable Diffusion, Dall-E).

Das Modell erscheint gleich in drei Ausführungen:

- Flux.1 Pro: Bezahlte und leistungsstärkste Version des Modells. Es werden spezielle Lösungen für Unternehmen angeboten.

- Flux.1 Dev: Basiert auf Flux.1 Pro, ist aber für die nicht-kommerzielle Nutzung des Tools und der erstellten Bilder gedacht.

- Flux.1 schnell: Diese Variante ist frei verfügbar und soll für die lokale Entwicklung und den persönlichen Gebrauch verwendet werden.

Alle Berichte zu Flux.1, die wir bisher online gefunden haben, sind positiv überrascht und finden, dass Flux.1 auf jeden Fall mit den anderen Modellen mithalten kann, wenn nicht sogar tatsächlich besser ist. Besonders die Qualität der Bilder und die Wiedergabe von Text sollen bei Flux.1 überdurchschnittlich gut funktionieren.

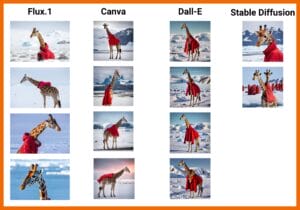

Die kostenfreie Variante kannst du einfach über die Plattform Replicate ausprobieren. Wir haben uns auch mal daran versucht und die Bilder von Flux.1, Dall-E, Canva und Stable Diffusion mal getestet. Wir finden, Flux.1 kann auf jeden Fall mithalten. Ob die Bilder besser sind, ist wahrscheinlich Geschmacksache. Unser Favorite sind übrigens die Hände der Giraffe auf dem 3. Bild von Flux.

Unser Prompt: photo of a giraffe in antarctica, trying to warm itself with a red coat

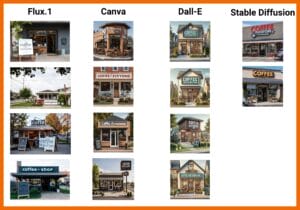

Auch die Funktion für Texte haben wir getestet: Tatsächlich hat das mit der Schrift bei Dall-E etwas besser funktioniert, als bei Flux.1. Canva und Stable Diffusion schneiden hier aber noch schnelchter ab.

Unser Prompt: coffeeshop from the outside in a suburban setting with a big sign in the front that says „coffee for everyone“

Hast du Flux.1 bereits ausprobiert? Was sind deine Erfahrungen?

Google Search Console spricht Empfehlungen aus

Google hat angekündigt, Empfehlungen in der Google Search Console in den nächsten Monaten über alle Accounts hinweg auszurollen. Die ersten Nutzer:innen können nun Gebrauch von der Hilfestellung machen.

Google hat angekündigt, Empfehlungen in der Google Search Console in den nächsten Monaten über alle Accounts hinweg auszurollen. Die ersten Nutzer:innen können nun Gebrauch von der Hilfestellung machen.

Google betont, dass für die Empfehlungen lediglich die Daten verwendet werden, welche die Nutzenden selber in ihrem Account einsehen können. Nur werden diese eben von einer KI ausgewertet und anschließend Maßnahmen vorgeschlagen, welche die Performance verbessern könnten (ähnlich wie in Google Ads). Ebenso sollen Empfehlungen nur angezeigt werden, wenn sie wirklich sinnvoll sind. Es kann also sein, dass du keine Empfehlungen siehst, obwohl die Funktion in deinem Account bereits ausgerollt wurde.

Wie hilfreich ist dieser Artikel für dich?

Noch ein Schritt, damit wir besser werden können: Bitte schreibe uns, was dir am Beitrag nicht gefallen hat.

Noch ein Schritt, damit wir besser werden können: Bitte schreibe uns, was dir am Beitrag nicht gefallen hat.

Vielen Dank für dein Feedback! Es hilft uns sehr weiter.

gar nicht hilfreich

weniger hilfreich

eher hilfreich

sehr hilfreich

ich habe ein anderes Thema gesucht